Новости Искусственного Интеллекта

GenCast, новая модель искусственного интеллекта от Google DeepMind, обладает точностью, достаточной для конкуренции с традиционным метеопрогнозом. Согласно недавно опубликованному исследованию, она превзошла одну из ведущих моделей прогноза, когда была проверена на данных 2019 года.

Искусственный интеллект в ближайшее время не заменит традиционные методы прогнозирования, но может стать дополнительным инструментом для предсказания погоды и предупреждения общественности о сильных штормах. GenCast — одна из нескольких моделей ИИ для прогнозирования погоды, которые могут привести к более точным прогнозам.

"Погода, по сути, затрагивает каждый аспект нашей жизни... это также одна из больших научных задач — прогнозирование погоды," — говорит Илан Прайс, ведущий научный сотрудник DeepMind. "Google DeepMind ставит перед собой миссию по развитию ИИ на благо человечества. И я считаю, что это важный способ, важный вклад в этом направлении."

Прайс и его коллеги протестировали GenCast на фоне системы ENS, одной из лучших в мире моделей прогноза, которой руководит Европейский центр среднесрочных прогнозов погоды (ECMWF). Согласно исследованию, опубликованному на этой неделе в журнале Nature, GenCast превзошёл ENS в 97,2% случаев.

GenCast — это модель прогнозирования погоды на базе машинного обучения, обученная на данных о погоде с 1979 по 2018 год. Модель учится распознавать закономерности в четырёх десятилетиях исторических данных и использует это для прогнозирования того, что может произойти в будущем. Это заметно отличается от того, как работают традиционные модели, такие как ENS, которые всё ещё полагаются на суперкомпьютеры для решения сложных уравнений с целью симуляции физики атмосферы. Как GenCast, так и ENS создают ансамблевые прогнозы, которые предлагают диапазон возможных сценариев.

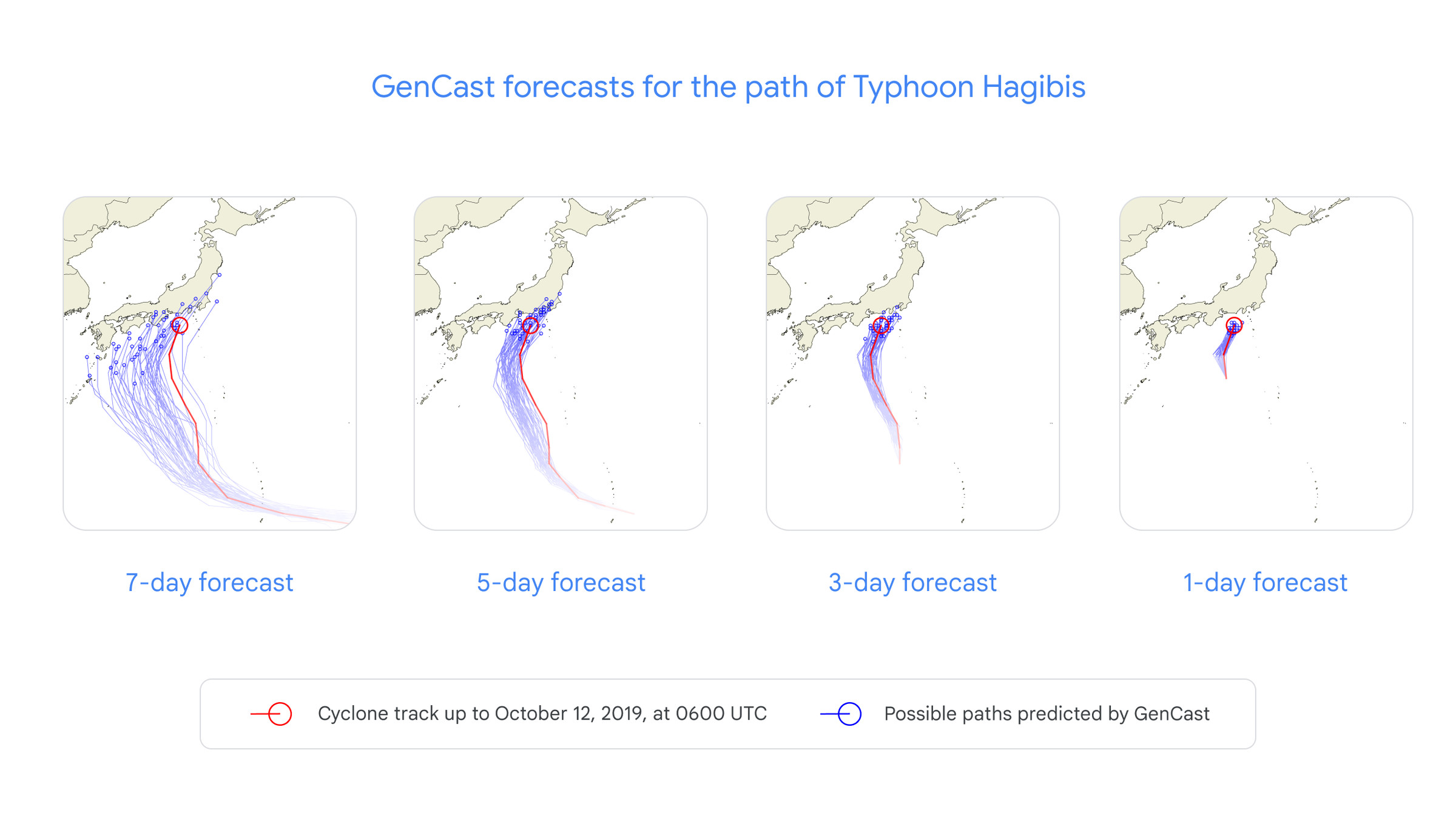

Например, в вопросе прогнозирования траектории тропического циклона GenCast смог обеспечить дополнительное предупреждение в среднем на 12 часов. GenCast в целом оказался лучше в прогнозировании траекторий циклонов, экстремальных погодных явлений и производства энергии ветра за 15 дней вперёд.

Прогноз от GenCast демонстрирует диапазон возможных траекторий тайфуна Хагибис, которые становятся более точными по мере приближения циклона к побережью Японии.

Одно из замечаний заключается в том, что GenCast протестировал себя на более старой версии ENS, которая теперь работает с более высоким разрешением. Рецензируемое исследование сравнивает прогнозы GenCast с прогнозами ENS за 2019 год, оценивая, насколько точно каждая модель соответствовала реальным условиям в том году. По словам координатора машинного обучения ECMWF Мэтта Чантри, система ENS значительно улучшилась с 2019 года. Это затрудняет оценку того, насколько хорошо GenCast может конкурировать с ENS в настоящее время.

Стоит отметить, что разрешение — не единственный важный фактор при составлении точных прогнозов. В 2019 году ENS уже работала с чуть более высоким разрешением, чем GenCast, однако GenCast всё равно удалось её превзойти. DeepMind утверждает, что проводила аналогичные исследования на данных с 2020 по 2022 год и получила схожие результаты, хотя они ещё не были рецензированы. Однако данных для сравнений за 2023 год, когда ENS начала работать с значительно более высоким разрешением, у них не было.

Разделяя мир на сетку, GenCast работает с разрешением 0,25 градуса — это значит, что каждый квадрат на этой сетке составляет четверть градуса широты и четверть градуса долготы. В сравнении, ENS использовала разрешение 0,2 градуса в 2019 году и сейчас работает с разрешением 0,1 градуса.

Тем не менее, разработка GenCast "является значительным этапом в эволюции прогнозирования погоды", отметил Чантри в заявлении, отправленном по электронной почте. Наряду с ENS, ECMWF также утверждает, что запускает свою собственную версию системы машинного обучения, которая, по словам Чантри, "вдохновлена GenCast".

Скорость является преимуществом GenCast. Он может создать 15-дневный прогноз всего за восемь минут, используя один TPU v5 Google Cloud. Моделям, основанным на физических процессах, как ENS, возможно, потребуется несколько часов для выполнения той же задачи. GenCast обходит уравнения, которые ENS должна решать, поэтому ему требуется меньше времени и вычислительных мощностей для создания прогноза.

"С вычислительной точки зрения, запуск традиционных прогнозов обходится на порядки дороже по сравнению с моделью, такой как GenCast", говорит Прайс.

Эта эффективность может уменьшить некоторые опасения относительно воздействия на окружающую среду энергозатратных центров обработки данных ИИ, которые уже привели к увеличению выбросов парниковых газов Google в последние годы. Однако сложно определить, как GenCast соотносится с моделями, основанными на физических процессах, с точки зрения устойчивости, не зная, сколько энергии требуется для обучения модели машинного обучения.

У GenCast ещё есть возможности для улучшений, включая потенциальное увеличение разрешения. Кроме того, GenCast выпускает прогнозы с интервалом в 12 часов по сравнению с традиционными моделями, которые обычно обновляются на более коротких интервалах. Это может повлиять на то, как эти прогнозы могут использоваться в реальной жизни (например, для оценки доступной мощности ветра).

"Вы бы хотели знать, что ветер будет делать в течение всего дня, а не только в 6 утра и 6 вечера", говорит Стивен Малленс, преподаватель метеорологии Университета Флориды, не участвовавший в исследовании GenCast.

Хотя интерес к использованию ИИ для улучшения прогнозов растет, он всё ещё должен доказать свою эффективность. "Люди обращают на это внимание. Я не думаю, что метеорологическое сообщество в целом полностью уверено в этом", говорит Малленс. "Мы обученные учёные, которые мыслят в терминах физики ... и поскольку ИИ в основе своей не является таковым, то остаётся элемент сомнения: является ли это хорошим и почему?"

Прогнозисты могут самостоятельно попробовать GenCast; DeepMind выпустила код своей модели с открытым исходным кодом. Прайс говорит, что видит применение GenCast и более развитых моделей ИИ в реальной жизни наряду с традиционными моделями. "Когда эти модели попадают в руки практиков, это ещё больше укрепляет доверие и уверенность", говорит Прайс. "Мы действительно хотим, чтобы это оказало широкое социальное воздействие".

Источник: Модель предсказания погоды с использованием ИИ от Google демонстрирует весьма высокую точность